Kategorie:

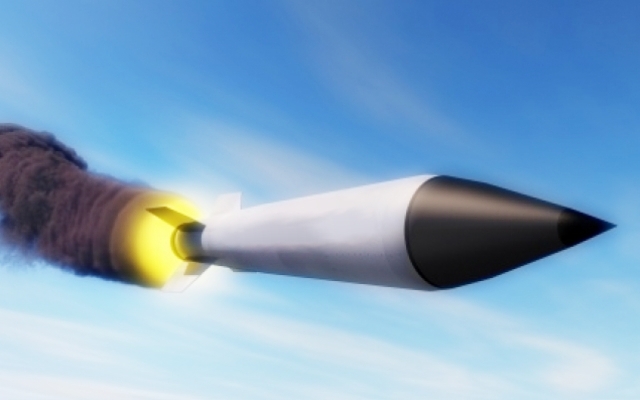

Sztuczna inteligencja rozwija się w szybkim tempie i znajduje zastosowanie praktycznie we wszystkich obszarach naszego życia. Nie od dziś wiadomo, że sztuczna inteligencja jest wykorzystywana przede wszystkim do celów militarnych. Zdaniem ekspertów, którzy podeszli do tego problemu racjonalnie, algorytmy komputerowe będą mogły w przyszłości wpłynąć na procesy decyzyjne i doprowadzić do wojny jądrowej.

Światowe mocarstwa militaryzują sztuczną inteligencję, ponieważ jest ona wydajniejsza od człowieka, potrafi znacznie szybciej przetwarzać dane oraz podejmować szybkie i chłodne decyzje. Jest to sfera, w której człowiek może angażować zbyt wielkie emocje, przez co może podejmować błędne decyzje.

Jednak z drugiej strony, zastąpienie ludzi sztuczną inteligencją mogłoby doprowadzić do globalnej katastrofy. Przynajmniej na dzień dzisiejszy, na nasze szczęście, żadne państwo nie ma zamiaru oddawać swojego arsenału nuklearnego „w ręce” algorytmów komputerowych. Decyzje o wykorzystaniu broni nuklearnej są i będą podejmowane przez człowieka, lecz nawet w takiej sytuacji nie da się uniknąć błędu, a sztuczna inteligencja mimo wszystko może wpędzić nas w globalną wojnę jądrową.

Eksperci z amerykańskiego think tanku, korporacji RAND wskazują, że zmilitaryzowana sztuczna inteligencja może nam zagrozić na różne sposoby. Jeden z przykładów przedstawionych w raporcie opisuje sytuację, w której jedno państwo może zdać sobie sprawę z potęgi SI posiadanej przez przeciwnika i zdecyduje się na atak wyprzedzający, aby nie dopuścić do zachwiania globalnej równowagi sił. Takie uderzenie może zainicjować szereg przykrych zdarzeń, które w najgorszym przypadku doprowadzą do wymiany ognia nuklearnego.

Specjaliści z korporacji RAND twierdzą również, że sztuczna inteligencja może naruszyć podstawowe reguły odstraszania nuklearnego i wpłynąć na ludzi w taki sposób, aby podjęli katastrofalne w skutkach decyzje. Może to być np. zasugerowanie ataku jądrowego w oparciu o źle zinterpretowane dane lub błąd systemu. Należy również mieć na uwadze, że komputery zawsze będą narażone na cyberataki, zatem zhakowana sztuczna inteligencja może zwyczajnie wprowadzać ludzi w błąd. Eksperci z RAND podsumowują, że do 2040 roku SI nie będzie jeszcze na tyle zaawansowana, aby mogła wywierać wpływ na politykę bezpieczeństwa nuklearnego.

Komentarze

Skomentuj