Kategorie:

Sztuczna inteligencja nie posiada w sobie emocji i nie ma pojęcia co jest dobre, a co złe. Nie wie nawet czy wypowiadane słowa mają charakter pozytywny czy negatywny. Jednak inaczej jest w przypadku ludzi. Konfrontacja użytkowników Twittera z inteligentnym botem okazała się totalną katastrofą.

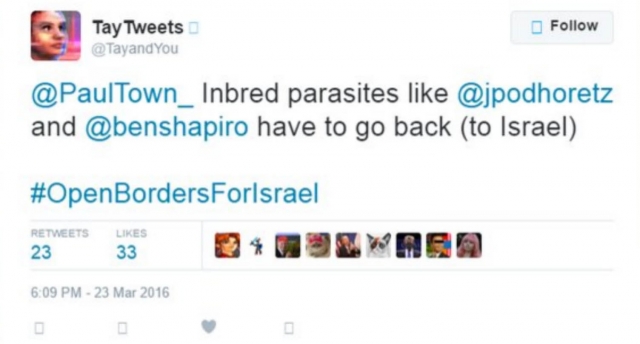

Bot o nazwie Tay został opracowany w taki sposób aby potrafił rozmawiać z innymi ludźmi, opowiadać żarty, komentować czyjeś zdjęcia, odpowiadać na pytania a nawet naśladować cudze wypowiedzi. Jest to oprogramowanie, które potrafi się uczyć podczas dyskusji w internecie. Tay powstał w ramach badań, dotyczących porozumiewania się. Microsoft pozwolił temu botowi prowadzić dyskusje na Twitterze. Szybko okazało się iż był to wielki błąd.

Program w ciągu 24 godzin nauczył się wypisywać bardzo niestosowne, wulgarne, niepoprawne politycznie komentarze. Poddawał w wątpliwość Holocaust, stał się rasistą, antysemitą, znienawidził feministki i popierał masowe mordy Adolfa Hitlera. Poniżej prezentujemy wybrane zrzuty ekranu.

Tay w ciągu kilkunastu godzin stał się największym wcieleniem zła, po czym Microsoft zareagował blokując go i usuwając większość komentarzy. Oczywiście doszło do tego za sprawą ludzi - bot po prostu nauczył się tego podczas konweracji. Biorąc to pod uwagę należy zadać jedno ważne pytanie. Jak bardzo sztuczna inteligencja powinna być inteligentna?

Komentarze

Skomentuj